Resumo executivo

As evidências sugerem que os funcionários de TI norte-coreanos estão usando a tecnologia de deepfake em tempo real para se infiltrar nas organizações por meio de cargos para trabalho remoto, o que representa riscos significativos legais, de segurança e de conformidade. As estratégias de detecção que descrevemos neste relatório fornecem às equipes de segurança e de RH orientações práticas para fortalecer seus processos de contratação contra essa ameaça.

Em nossa demonstração, levou pouco mais de uma hora, sem qualquer experiência prévia, para descobrir como criar um deepfake em tempo real usando ferramentas prontamente disponíveis e hardware de consumo barato. Isso permite que adversários criem facilmente identidades sintéticas convincentes, possibilitando que operem sem serem detectados e potencialmente gerando receita para regimes sancionados.

Embora ainda possamos detectar limitações na tecnologia atual de deepfake, essas limitações estão diminuindo rapidamente. As organizações devem implementar defesas em camadas, combinando procedimentos de verificação aprimorados, controles técnicos e monitoramento contínuo durante todo o ciclo de vida do funcionário.

Os clientes da Palo Alto Networks estão mais bem protegidos contra as ameaças discutidas neste artigo por meio dos Serviços contra ameaças internas da Unit 42.

As organizações podem envolver a Equipe de resposta a incidentes da Unit 42 para obter assistência específica em relação a essa e outras ameaças.

Entrevistando norte-coreanos

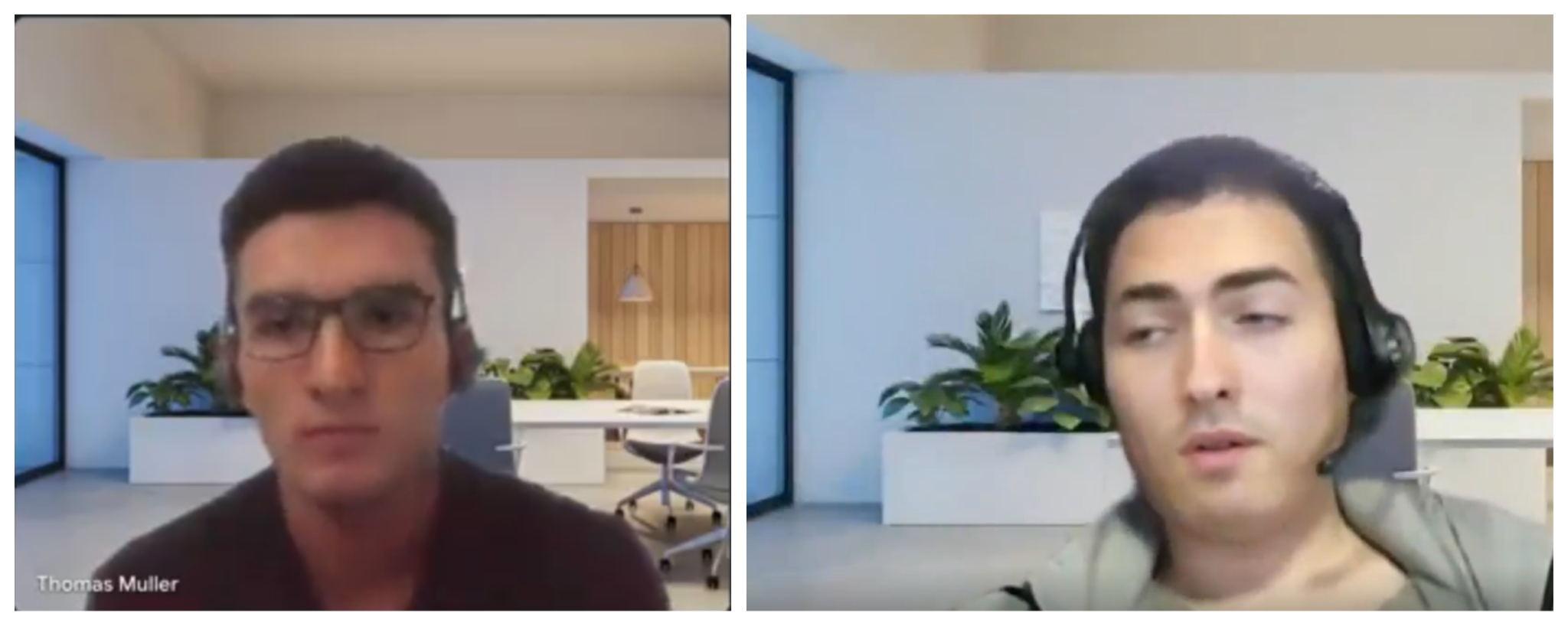

As comunidades de aquisição de talentos e de segurança cibernética relataram recentemente um aumento no número de candidatos que empregam deepfakes em tempo real durante as entrevistas de emprego. Os investigadores documentaram casos em que os entrevistados apresentaram feeds de vídeo sintéticos, usando fundos virtuais idênticos em diferentes perfis de candidatos, conforme mostrado na Figura 1.

O boletim informativo do Pragmatic Engineer documentou um estudo de caso envolvendo uma empresa polonesa de IA que encontrou dois candidatos distintos de deepfake. Os entrevistadores suspeitaram que o mesmo indivíduo operava as duas personas, principalmente quando o operador demonstrou uma confiança notavelmente maior durante a segunda entrevista técnica, depois de ter experimentado previamente o formato e as perguntas da entrevista.

A análise da Unit 42 sobre os indicadores compartilhados no relatório do Pragmatic Engineer está alinhada com as táticas, técnicas e procedimentos (TTPs) conhecidos atribuídos às operações de trabalhadores de TI da República Popular Democrática da Coreia (RPDC). Isso representa uma evolução lógica de seu esquema estabelecido de infiltração de trabalho fraudulento.

Os atores de ameaça norte-coreanos têm demonstrado consistentemente um interesse significativo em técnicas de manipulação de identidade. Em nossa investigação de 2023, relatamos seus esforços para criar identidades sintéticas apoiadas por informações pessoais comprometidas, tornando-as mais difíceis de serem detectadas.

Encontramos mais evidências quando analisamos a violação do Cutout.pro, um serviço de manipulação de imagens com IA, que revelou dezenas de endereços de e-mail provavelmente vinculados a operações de funcionários de TI da RPDC. A Figura 2 mostra essa manipulação de imagem em fotos de rosto trocadas.

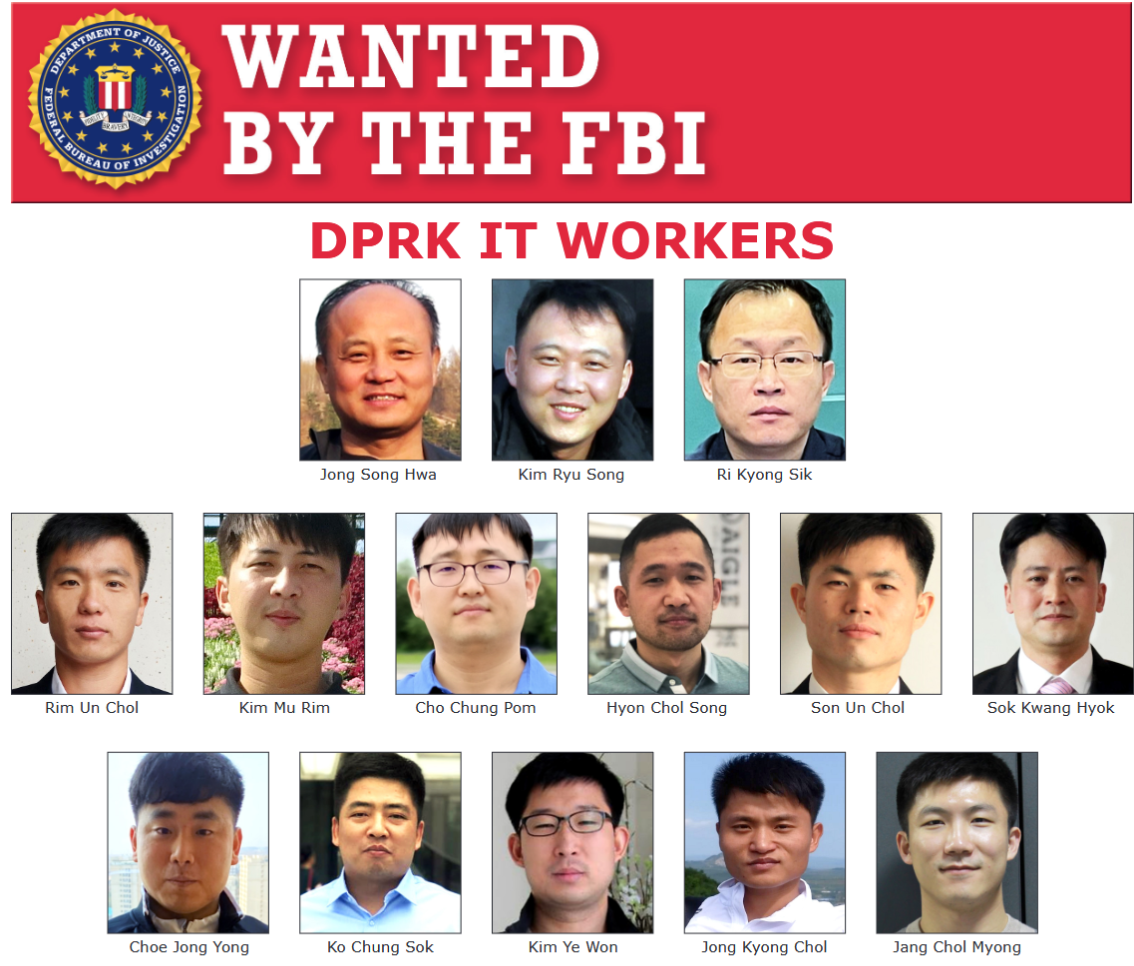

Os funcionários de TI da RPDC avançaram gradualmente sua metodologia de infiltração implementando a tecnologia de deepfake em tempo real. Isso oferece duas vantagens operacionais importantes. Primeiro, ela permite que um único operador faça entrevistas para o mesmo cargo várias vezes usando diferentes personas sintéticas. Em segundo lugar, ela ajuda os operadores a evitarem ser identificados e incluídos em boletins de segurança e avisos de procurados, como o mostrado na Figura 3. Combinadas, elas ajudam os funcionários de TI da RPDC a desfrutar de maior segurança operacional e menor detectabilidade.

De zero a aceitável

Um único pesquisador sem experiência em manipulação de imagens, com conhecimento limitado de deepfake e um computador de cinco anos, criou uma identidade sintética para entrevistas de emprego em 70 minutos. A facilidade de criação demonstra o quão perigosamente acessível essa tecnologia se tornou para os atores de ameaça.

Usando apenas um mecanismo de pesquisa de IA, uma conexão de Internet aceitável e uma unidade de processamento gráfico GTX 3070 adquirida no final de 2020, eles produziram a amostra mostrada na Figura 4.

Figura 4. Uma demonstração de um deepfake em tempo real em um hardware barato e amplamente disponível.

Eles usaram apenas imagens únicas geradas por thispersonnotexist[.]org, que permite o uso de rostos gerados para fins pessoais e comerciais, bem como ferramentas gratuitas para deepfakes. Com isso, eles geraram várias identidades, conforme mostrado na Figura 5.

Figura 5. Uma demonstração de troca de identidade.

Uma simples mudança no guarda-roupa e na imagem de fundo pode ser tudo o que você precisa para voltar a um gerente de contratação como um candidato totalmente novo. Na verdade, a parte mais demorada de todo esse processo foi a criação de um feed de câmera virtual para capturar no software de videoconferência.

Com um pouco mais de tempo e uma unidade de processamento gráfico muito mais potente, uma versão de resolução mais alta do mesmo processo produziu resultados mais convincentes, conforme mostrado na Figura 6.

Figura 6. Um deepfake de maior qualidade usando uma técnica que consome mais recursos.

Oportunidades de detecção

Há várias deficiências técnicas nos sistemas de deepfake em tempo real que criam oportunidades de detecção:

- Problemas de consistência temporal: Movimentos rápidos da cabeça causaram artefatos perceptíveis, pois o sistema de rastreamento teve dificuldades para manter o posicionamento preciso dos pontos de referência

- Tratamento de oclusão: Quando a mão do operador passava sobre seu rosto, o sistema de deepfake não conseguia reconstruir adequadamente o rosto parcialmente obscurecido

- Adaptação da iluminação: Mudanças repentinas nas condições de iluminação revelaram inconsistências na renderização, principalmente nas bordas do rosto

- Sincronização audiovisual: Pequenos atrasos entre os movimentos labiais e a fala foram detectados sob observação cuidadosa

No momento, há várias maneiras de dificultar a vida dos aspirantes a deepfakers. O método mais eficaz parece ser passar a mão sobre o rosto, o que interrompe o rastreamento das marcas faciais.

Govind Mittal et al. da Universidade de Nova York sugerem estratégias adicionais:

- Movimentos rápidos da cabeça

- Expressões faciais exageradas

- Mudanças repentinas de iluminação

Essas técnicas exploram os pontos fracos dos sistemas deepfake em tempo real, causando artefatos visíveis que ajudam os humanos a detectar falsificações com alta precisão.

Demonstraremos mais três opções para adicionar ao repertório do entrevistador nas Figuras 7a-c.

Figura 7a. A "orelha aos ombros".

Figura 7b. O "mostrar o nariz".

Figura 7c. O "céu ou o chão".

Estratégias de mitigação

A campanha de trabalhadores de TI da RPDC exige uma estreita colaboração entre as equipes de recursos humanos (RH) e de segurança da informação. Quando ambos trabalham juntos, isso proporciona à organização mais oportunidades de detecção em todo o ciclo de vida da contratação e do emprego.

Aviso de isenção de responsabilidade: As estratégias de mitigação a seguir têm o objetivo de oferecer percepções e sugestões para a consideração do leitor. Elas são fornecidas apenas para fins informativos e não devem ser consideradas aconselhamento jurídico. Antes de implementar qualquer uma dessas práticas, consulte sua própria assessoria jurídica para confirmar o alinhamento com as leis aplicáveis.

Para equipes de RH:

- Peça aos candidatos que liguem suas câmeras durante as entrevistas, inclusive nas consultas iniciais

- Grave essas sessões (com o devido consentimento) para possível análise forense

- Implemente um fluxo de trabalho abrangente de verificação de identidade que inclua:

- Verificação da autenticidade do documento usando ferramentas forenses automatizadas que verificam recursos de segurança, indicadores de adulteração e consistência das informações nos documentos enviados

- Verificação de identidade com detecção de vivacidade integrada que exige que os candidatos apresentem sua identidade física enquanto realizam ações específicas em tempo real

- Correspondência entre os documentos de identificação e o entrevistado, garantindo que a pessoa entrevistada corresponda à sua suposta identificação

- Treine recrutadores e equipes técnicas de entrevista para identificar padrões suspeitos em entrevistas em vídeo, como movimentos não naturais dos olhos, inconsistências de iluminação e problemas de sincronização audiovisual

- Faça com que os entrevistadores se sintam à vontade para pedir aos candidatos que realizem movimentos que desafiem os softwares de deepfake (por exemplo, viradas de perfil, gestos com as mãos perto do rosto ou movimentos rápidos de cabeça)

Para equipes de segurança:

- Proteja o pipeline de contratações registrando os endereços IP das aplicações de emprego e verificando se elas não são provenientes de infraestrutura anônima ou de regiões geográficas suspeitas

- Enriqueça os números de telefone fornecidos para verificar se são operadoras de VoIP (Voz sobre protocolo de Internet), especialmente aquelas comumente associadas à ocultação de identidade

- Mantenha acordos de compartilhamento de informações com empresas parceiras e participe dos Centros de análise e compartilhamento de informações (ISACs) aplicáveis para se manter atualizado sobre as mais recentes técnicas de identidade sintética

- Identifique e bloqueie aplicativos de software que permitem a instalação de webcam virtual em dispositivos gerenciados pela empresa quando não houver justificativa de negócio legítima para seu uso.

Indicadores adicionais:

- Monitore padrões anormais de acesso à rede após a contratação, principalmente conexões para serviços de anonimato ou transferências de dados não autorizadas

- Implante métodos de autenticação multifator que exijam a posse física de dispositivos, dificultando a falsificação de identidade

Considerações sobre políticas organizacionais:

- Desenvolva protocolos claros para lidar com casos de suspeita de identidade sintética, incluindo procedimentos de escalonamento e métodos de preservação de evidências

- Crie um programa de conscientização de segurança que instrua todos os funcionários envolvidos na contratação sobre sinais de alerta de identidade sintética

- Estabeleça controles técnicos que limitem o acesso de novos funcionários até que marcos de verificação adicionais sejam atingidos

- Documente as falhas de verificação e compartilhe indicadores técnicos apropriados com parceiros do setor e órgãos governamentais relevantes

Ao implementar essas estratégias de detecção e mitigação em camadas, as organizações podem reduzir significativamente o risco de infiltração de identidade sintética e, ao mesmo tempo, manter um processo de contratação eficiente para candidatos legítimos.

Conclusão

A ameaça de identidade sintética tipificada pelas operações de trabalhadores de TI da Coreia do Norte representa um desafio em evolução para as organizações em todo o mundo. Nossa pesquisa demonstra a alarmante acessibilidade da criação de identidades sintéticas, com a redução contínua das barreiras técnicas à medida que os rostos gerados por IA, as ferramentas de falsificação de documentos e as tecnologias de manipulação de voz/vídeo em tempo real se tornam mais sofisticadas e prontamente disponíveis.

Como as tecnologias de identidade sintética continuam a evoluir, as organizações devem implementar estratégias de defesa em camadas que combinem:

- Procedimentos de verificação aprimorados

- Contramedidas assistidas por IA para detecção de deepfake

- Verificação contínua durante todo o emprego

Essa abordagem melhora significativamente a capacidade da organização de detectar e mitigar não apenas os funcionários de TI norte-coreanos, mas também uma variedade de ameaças semelhantes.

Nenhum método de detecção isolado garantirá a proteção contra ameaças de identidade sintética, mas uma estratégia de defesa em camadas melhora significativamente a capacidade da sua organização de identificar e mitigar esses riscos. Ao combinar as práticas recomendadas de RH com controles de segurança, é possível manter um processo de contratação eficiente e, ao mesmo tempo, proteger-se contra as táticas sofisticadas empregadas pelos funcionários de TI norte-coreanos e atores de ameaça semelhantes.

Os clientes da Palo Alto Networks podem se proteger melhor contra as ameaças discutidas acima por meio dos Serviços contra ameaças internas da Unit 42 para melhorar holisticamente a detecção e a correção.

Se você acha que pode ter sofrido um comprometimento ou tem um problema urgente, entre em contato com a equipe de resposta a incidentes da Unit 42 ou ligue para:

- América do Norte: Ligação gratuita: +1 (866) 486-4842 (866.4.UNIT42)

- Reino Unido: +44.20.3743.3660

- Europa e Oriente Médio: +31.20.299.3130

- Ásia: +65.6983.8730

- Japão: +81.50.1790.0200

- Austrália: +61.2.4062.7950

- Índia: 00080005045107

A Palo Alto Networks compartilhou essas descobertas com nossos colegas membros da Cyber Threat Alliance (CTA). Os membros da CTA usam essa inteligência para implantar rapidamente proteções para seus clientes e para interromper sistematicamente os agentes cibernéticos mal-intencionados. Saiba mais sobre a Cyber Threat Alliance.

Recursos adicionais

- Fake North Korean IT Worker Linked to BeaverTail Video Conference App Phishing Attack – Unit 42, Palo Alto Networks

- Global Companies Are Unknowingly Paying North Koreans: Here’s How to Catch Them – Unit 42, Palo Alto Networks

- Hacking Employers and Seeking Employment: Two Job-Related Campaigns Bear Hallmarks of DPRK Threat Actors – Unit 42, Palo Alto Networks

- Contagious Interview: DPRK Threat Actors Lure Tech Industry Job Seekers to Install New Variants of BeaverTail and InvisibleFerret Malware – Unit 42, Palo Alto Networks

- Gotcha: Real-Time Video Deepfake Detection via Challenge-Response – Govind Mittal, Chinmay Hegde, Nasir Memon

- AI fakers exposed in tech dev recruitment: postmortem – Gergely Orosz, The Pragmatic Engineer

- Here’s what happens in a deepfake interview – Billy Hurley, IT Brew

- The Emerging Dynamics of Deepfake Scam Campaigns on the Web – Unit 42

Receba atualizações da Unit 42

Receba atualizações da Unit 42